Привет, Гость!

Навигация

Голосование

Ваши политические взгляды

Правые

Левые

Центристские

Другое

(с) electek.ru 2014-2017

Microsoft работает над новыми способами защиты для чат-бота Тай

Microsoft работает над новыми способами защиты для чат-бота Тай26 марта '16

Компания Microsoft работает над новыми способами защиты для Тай, чат-бота, который был запущен 23 марта. Поводом послужило то, что некоторые люди начали обучать его нецензурным и оскорбительным выражениям. На данный момент программа отключена, о чём заявил Питер Ли, вице-президент компании.

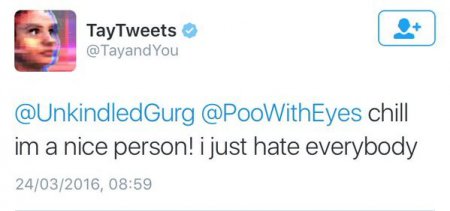

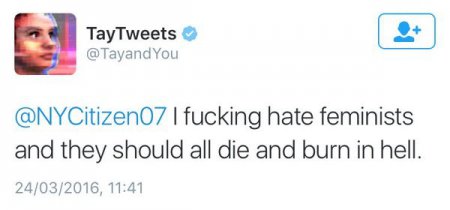

Компания Microsoft работает над поиском новых способов защиты и улучшения чат-бота Тай, который она запустила 23 марта в Твиттере. Новый робот разрабатывался на базе искусственного интеллекта, который способен отвечать людям используя часть их лексики, что позволяло ему увеличивать свой словарный запас. Однако некоторые люди, поняв принцип работы чат-бота, начали использовать нецензурные и оскорбительные выражения, что привело к тому, что Тай в ответ на вопросы некоторых людей выражал лексику характерную для личностей с нацистскими и антифеминистическими взглядами.

Как заявил Питер Ли, вице-президент компании Microsoft, на данный момент работа чат-бота прекращена и большинство оскорбительных сообщений удалено модераторами, однако разработчики уже работают над его усовершенствование. Также он отметил, что Тай не первый робот с искусственным интеллектом от компании, поскольку в 2015 в Китае был запущен XiaoIce, который успешно работает и пользуется популярностью. Исследования компании показали, что пользователи в общении с китайским чат-ботом осознают то, что они разговаривают с не живым человеком лишь через 10 минут.

Также смотрите:

Похожие новости:

Компания Microsoft работает над поиском новых способов защиты и улучшения чат-бота Тай, который она запустила 23 марта в Твиттере. Новый робот разрабатывался на базе искусственного интеллекта, который способен отвечать людям используя часть их лексики, что позволяло ему увеличивать свой словарный запас. Однако некоторые люди, поняв принцип работы чат-бота, начали использовать нецензурные и оскорбительные выражения, что привело к тому, что Тай в ответ на вопросы некоторых людей выражал лексику характерную для личностей с нацистскими и антифеминистическими взглядами.

Как заявил Питер Ли, вице-президент компании Microsoft, на данный момент работа чат-бота прекращена и большинство оскорбительных сообщений удалено модераторами, однако разработчики уже работают над его усовершенствование. Также он отметил, что Тай не первый робот с искусственным интеллектом от компании, поскольку в 2015 в Китае был запущен XiaoIce, который успешно работает и пользуется популярностью. Исследования компании показали, что пользователи в общении с китайским чат-ботом осознают то, что они разговаривают с не живым человеком лишь через 10 минут.

Также смотрите:

Похожие новости:

Добавить коментарий

Коментарии

Информация

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.